写给程序员的机器学习入门 (二) - pytorch 与矩阵计算入门(一)

传统的机器学习有的会像前一节的例子中全部手写,或者利用 numpy 类库减少一部分工作量,也有人会利用 scikit-learn (基于 numpy) 类库封装好的各种经典算法。pytorch 与 tensorflow 和传统机器学习不一样的是,它们把重点放在了组建类似人脑的神经元网络 (Neural Network),所以能实现传统机器学习无法做到的非常复杂的判断,例如判断图片中的物体类型,自动驾驶等。不过,它们组建的神经元网络工作方式是不是真的和人脑类似仍然有很多争议,目前已经有人开始着手组建原理上更接近人脑的 GNN (Graph Neural Network) 网络,但仍未实用化,所以我们这个系列还是会着重讲解当前已经实用化并广泛应用在各个行业的网络模型。

学 pytorch 还是学 tensorflow 好?

对初学者来说一个很常见的问题是,学 pytorch 还是学 tensorflow 好?按目前的统计数据来说,公司更多使用 tensorflow,而研究人员更多使用 pytorch,pytorch 的增长速度非常快,有超越 tensorflow 的趋势。我的意见是学哪个都无所谓,如果你熟悉 pytorch,学 tensorflow 也就一两天的事情,反过来也一样,并且 pytorch 和 tensorflow 的项目可以互相移植,选一个觉得好学的就可以了。因为我觉得 pytorch 更好学 (封装非常直观,使用 Dynamic Graph 使得调试非常容易),所以这个系列会基于 pytorch 来讲。

Dynamic Graph 与 Static Graph

机器学习框架按运算的流程是否需要预先固定可以分为 Dynamic Graph 和 Static Graph,Dynamic Graph 不需要预先固定运算流程,而 Static Graph 需要。举例来说,对同一个公式 wx + b = y,Dynamic Graph 型的框架可以把 wx,+b 分开写并且逐步计算,计算的过程中随时都可以用 print 等指令输出途中的结果,或者把途中的结果发送到其他地方记录起来;而 Static Graph 型的框架必须预先定好整个计算流程,你只能传入 w, x, b 给计算器,然后让计算器输出 y,中途计算的结果只能使用专门的调试器来查看。

一般的来说 Static Graph 性能会比 Dynamic Graph 好,Tensorflow (老版本) 使用的是 Static Graph,而 pytorch 使用的是 Dynamic Graph,但两者实际性能相差很小,因为消耗资源的大部分都是矩阵运算,使用批次训练可以很大程度减少它们的差距。顺带一提,Tensorflow 1.7 开始支持了 Dynamic Graph,并且在 2.0 默认开启,但大部分人在使用 Tensorflow 的时候还是会用 Static Graph。

# Dynamic Graph 的印象,运算的每一步都可以插入自定义代码

def forward(w, x, b):

wx = w * x

print(wx)

y = wx + b

print(y)

return y

forward(w, x, b)

# Static Graph 的印象,需要预先编译整个计算流程

forward = compile("wx+b")

forward(w, x, b)

安装 pytorch

假设你已经安装了 python3,执行以下命令即可安装 pytorch:

pip3 install pytorch

之后在 python 代码中使用 import torch 即可引用 pytorch 类库。

pytorch 的基本操作

接下来我们熟悉一下 pytorch 里面最基本的操作,pytorch 会用 torch.Tensor 类型来统一表现数值,向量 (一维数组) 或矩阵 (多维数组),模型的参数也会使用这个类型。(tensorflow 会根据用途分为好几个类型,这点 pytorch 更简洁明了)

torch.Tensor 类型可以使用 torch.tensor 函数构建,以下是一些简单的例子(运行在 python 的 REPL 中):

# 引用 pytorch

>>> import torch

# 创建一个整数 tensor

>>> torch.tensor(1)

tensor(1)

# 创建一个小数 tensor

>>> torch.tensor(1.0)

tensor(1.)

# 单值 tensor 中的值可以用 item 函数取出

>>> torch.tensor(1.0).item()

1.0

# 使用一维数组创建一个向量 tensor

>>> torch.tensor([1.0, 2.0, 3.0])

tensor([1., 2., 3.])

# 使用二维数组创建一个矩阵 tensor

>>> torch.tensor([[1.0, 2.0, 3.0], [-1.0, -2.0, -3.0]])

tensor([[ 1., 2., 3.],

[-1., -2., -3.]])

tensor 对象的数值类型可以看它的 dtype 成员:

>>> torch.tensor(1).dtype

torch.int64

>>> torch.tensor(1.0).dtype

torch.float32

>>> torch.tensor([1.0, 2.0, 3.0]).dtype

torch.float32

>>> torch.tensor([[1.0, 2.0, 3.0], [-1.0, -2.0, -3.0]]).dtype

torch.float32

pytorch 支持整数类型 torch.uint8, torch.int8, torch.int16, torch.int32, torch.int64 ,浮点数类型 torch.float16, torch.float32, torch.float64,还有布尔值类型 torch.bool。类型后的数字代表它的位数 (bit 数),而 uint8 前面的 u 代表它是无符号数 (unsigned)。实际绝大部分场景都只会使用 torch.float32,虽然精度没有 torch.float64 高但它占用内存小并且运算速度快。注意一个 tensor 对象里面只能保存一种类型的数值,不能混合存放。

创建 tensor 对象时可以通过 dtype 参数强制指定类型:

>>> torch.tensor(1, dtype=torch.int32)

tensor(1, dtype=torch.int32)

>>> torch.tensor([1.1, 2.9, 3.5], dtype=torch.int32)

tensor([1, 2, 3], dtype=torch.int32)

>>> torch.tensor(1, dtype=torch.int64)

tensor(1)

>>> torch.tensor(1, dtype=torch.float32)

tensor(1.)

>>> torch.tensor(1, dtype=torch.float64)

tensor(1., dtype=torch.float64)

>>> torch.tensor([1, 2, 3], dtype=torch.float64)

tensor([1., 2., 3.], dtype=torch.float64)

>>> torch.tensor([1, 2, 0], dtype=torch.bool)

tensor([ True, True, False])

tensor 对象的形状可以看它的 shape 成员:

# 整数 tensor 的 shape 为空

>>> torch.tensor(1).shape

torch.Size([])

>>> torch.tensor(1.0).shape

torch.Size([])

# 数组 tensor 的 shape 只有一个值,代表数组的长度

>>> torch.tensor([1.0]).shape

torch.Size([1])

>>> torch.tensor([1.0, 2.0, 3.0]).shape

torch.Size([3])

# 矩阵 tensor 的 shape 根据它的维度而定,每个值代表各个维度的大小,这个例子代表矩阵有 2 行 3 列

>>> torch.tensor([[1.0, 2.0, 3.0], [-1.0, -2.0, -3.0]]).shape

torch.Size([2, 3])

tensor 对象与数值,tensor 对象与 tensor 对象之间可以进行运算:

>>> torch.tensor(1.0) * 2

tensor(2.)

>>> torch.tensor(1.0) * torch.tensor(2.0)

tensor(2.)

>>> torch.tensor(3.0) * torch.tensor(2.0)

tensor(6.)

向量和矩阵还可以批量进行运算(内部会并列化运算):

# 向量和数值之间的运算

>>> torch.tensor([1.0, 2.0, 3.0])

tensor([1., 2., 3.])

>>> torch.tensor([1.0, 2.0, 3.0]) * 3

tensor([3., 6., 9.])

>>> torch.tensor([1.0, 2.0, 3.0]) * 3 - 1

tensor([2., 5., 8.])

# 矩阵和单值 tensor 对象之间的运算

>>> torch.tensor([[1.0, 2.0, 3.0], [-1.0, -2.0, -3.0]])

tensor([[ 1., 2., 3.],

[-1., -2., -3.]])

>>> torch.tensor([[1.0, 2.0, 3.0], [-1.0, -2.0, -3.0]]) / torch.tensor(2)

tensor([[ 0.5000, 1.0000, 1.5000],

[-0.5000, -1.0000, -1.5000]])

# 矩阵和与矩阵最后一个维度相同长度向量之间的运算

>>> torch.tensor([[1.0, 2.0, 3.0], [-1.0, -2.0, -3.0]]) * torch.tensor([1.0, 1.5, 2.0])

tensor([[ 1., 3., 6.],

[-1., -3., -6.]])

tensor 对象之间的运算一般都会生成一个新的 tensor 对象,如果你想避免生成新对象 (提高性能),可以使用 _ 结尾的函数,它们会修改原有的对象:

# 生成新对象,原有对象不变,add 和 + 意义相同

>>> a = torch.tensor([1,2,3])

>>> b = torch.tensor([7,8,9])

>>> a.add(b)

tensor([ 8, 10, 12])

>>> a

tensor([1, 2, 3])

# 在原有对象上执行操作,避免生成新对象

>>> a.add_(b)

tensor([ 8, 10, 12])

>>> a

tensor([ 8, 10, 12])

pytorch 还提供了一系列方便的函数求最大值,最小值,平均值,标准差等:

>>> torch.tensor([1.0, 2.0, 3.0])

tensor([1., 2., 3.])

>>> torch.tensor([1.0, 2.0, 3.0]).min()

tensor(1.)

>>> torch.tensor([1.0, 2.0, 3.0]).max()

tensor(3.)

>>> torch.tensor([1.0, 2.0, 3.0]).mean()

tensor(2.)

>>> torch.tensor([1.0, 2.0, 3.0]).std()

tensor(1.)

pytorch 还支持比较 tensor 对象来生成布尔值类型的 tensor:

# tensor 对象与数值比较

>>> torch.tensor([1.0, 2.0, 3.0]) > 1.0

tensor([False, True, True])

>>> torch.tensor([1.0, 2.0, 3.0]) <= 2.0

tensor([ True, True, False])

# tensor 对象与 tensor 对象比较

>>> torch.tensor([1.0, 2.0, 3.0]) > torch.tensor([1.1, 1.9, 3.0])

tensor([False, True, False])

>>> torch.tensor([1.0, 2.0, 3.0]) <= torch.tensor([1.1, 1.9, 3.0])

tensor([ True, False, True])

pytorch 还支持生成指定形状的 tensor 对象:

# 生成 2 行 3 列的矩阵 tensor,值全部为 0

>>> torch.zeros(2, 3)

tensor([[0., 0., 0.],

[0., 0., 0.]])

# 生成 3 行 2 列的矩阵 tensor,值全部为 1

torch.ones(3, 2)

>>> torch.ones(3, 2)

tensor([[1., 1.],

[1., 1.],

[1., 1.]])

# 生成 3 行 2 列的矩阵 tensor,值全部为 100

>>> torch.full((3, 2), 100)

tensor([[100., 100.],

[100., 100.],

[100., 100.]])

# 生成 3 行 3 列的矩阵 tensor,值为范围 [0, 1) 的随机浮点数

>>> torch.rand(3, 3)

tensor([[0.4012, 0.2412, 0.1532],

[0.1178, 0.2319, 0.4056],

[0.7879, 0.8318, 0.7452]])

# 生成 3 行 3 列的矩阵 tensor,值为范围 [1, 10] 的随机整数

>>> (torch.rand(3, 3) * 10 + 1).long()

tensor([[ 8, 1, 5],

[ 8, 6, 5],

[ 1, 6, 10]])

# 和上面的写法效果一样

>>> torch.randint(1, 11, (3, 3))

tensor([[7, 1, 3],

[7, 9, 8],

[4, 7, 3]])

这里提到的操作只是常用的一部分,如果你想了解更多 tensor 对象支持的操作,可以参考以下文档:

pytorch 保存 tensor 使用的数据结构

为了减少内存占用与提升访问速度,pytorch 会使用一块连续的储存空间 (不管是在系统内存还是在 GPU 内存中) 保存 tensor,不管 tensor 是数值,向量还是矩阵。

我们可以使用 storage 查看 tensor 对象使用的储存空间:

# 数值的储存空间长度是 1

>>> torch.tensor(1).storage()

1

[torch.LongStorage of size 1]

# 向量的储存空间长度等于向量的长度

>>> torch.tensor([1, 2, 3], dtype=torch.float32).storage()

1.0

2.0

3.0

[torch.FloatStorage of size 3]

# 矩阵的储存空间长度等于所有维度相乘的结果,这里是 2 行 3 列总共 6 个元素

>>> torch.tensor([[1, 2, 3], [-1, -2, -3]], dtype=torch.float64).storage()

1.0

2.0

3.0

-1.0

-2.0

-3.0

[torch.DoubleStorage of size 6]

pytorch 会使用 stride 来确定一个 tensor 对象的维度:

# 储存空间有 6 个元素

>>> torch.tensor([[1, 2, 3], [-1, -2, -3]]).storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

# 第一个维度是 2,第二个维度是 3 (2 行 3 列)

>>> torch.tensor([[1, 2, 3], [-1, -2, -3]]).shape

torch.Size([2, 3])

# stride 的意义是表示每个维度之间元素的距离

# 第一个维度会按 3 个元素来切分 (6 个元素可以切分成 2 组),第二个维度会按 1 个元素来切分 (3 个元素)

>>> torch.tensor([[1, 2, 3], [-1, -2, -3]])

tensor([[ 1, 2, 3],

[-1, -2, -3]])

>>> torch.tensor([[1, 2, 3], [-1, -2, -3]]).stride()

(3, 1)

pytorch 的一个很强大的地方是,通过 view 函数可以修改 tensor 对象的维度 (内部改变了 stride),但是不需要创建新的储存空间并复制元素:

# 创建一个 2 行 3 列的矩阵

>>> a = torch.tensor([[1, 2, 3], [-1, -2, -3]])

>>> a

tensor([[ 1, 2, 3],

[-1, -2, -3]])

>>> a.shape

torch.Size([2, 3])

>>> a.stride()

(3, 1)

# 把维度改为 3 行 2 列

>>> b = a.view(3, 2)

>>> b

tensor([[ 1, 2],

[ 3, -1],

[-2, -3]])

>>> b.shape

torch.Size([3, 2])

>>> b.stride()

(2, 1)

# 转换为向量

>>> c = b.view(6)

>>> c

tensor([ 1, 2, 3, -1, -2, -3])

>>> c.shape

torch.Size([6])

>>> c.stride()

(1,)

# 它们的储存空间是一样的

>>> a.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

>>> b.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

>>> c.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

使用 stride 确定维度的另一个意义是它可以支持共用同一个空间实现转置 (Transpose) 操作:

# 创建一个 2 行 3 列的矩阵

>>> a = torch.tensor([[1, 2, 3], [-1, -2, -3]])

>>> a

tensor([[ 1, 2, 3],

[-1, -2, -3]])

>>> a.shape

torch.Size([2, 3])

>>> a.stride()

(3, 1)

# 使用转置操作交换维度 (行转列)

>>> b = a.transpose(0, 1)

>>> b

tensor([[ 1, -1],

[ 2, -2],

[ 3, -3]])

>>> b.shape

torch.Size([3, 2])

>>> b.stride()

(1, 3)

# 它们的储存空间是一样的

>>> a.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

>>> b.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

转置操作内部就是交换了指定维度在 stride 中对应的值,你可以根据前面的描述想想对象在转置后的矩阵中会如何划分。

现在再想想,如果把转置后的矩阵用 view 函数专为向量会变为什么?会变为 [1, -1, 2, -2, 3, -3] 吗?

实际上这样的操作会导致出错😱:

>>> b

tensor([[ 1, -1],

[ 2, -2],

[ 3, -3]])

>>> b.view(6)

Traceback (most recent call last):

File "<stdin>", line 1, in <module>

RuntimeError: view size is not compatible with input tensor's size and stride (at least one dimension spans across two contiguous subspaces). Use .reshape(...) instead.

这是因为转置后矩阵元素的自然顺序和储存空间中的顺序不一致,我们可以用 is_contiguous 函数来检测:

>>> a.is_contiguous()

True

>>> b.is_contiguous()

False

解决这个问题的方法是首先用 contiguous 函数把储存空间另外复制一份使得顺序一致,然后再用 view 函数改变维度;或者用更方便的 reshape 函数,reshape 函数会检测改变维度的时候是否需要复制储存空间,如果需要则复制,不需要则和 view 一样只修改内部的 stride。

>>> b.contiguous().view(6)

tensor([ 1, -1, 2, -2, 3, -3])

>>> b.reshape(6)

tensor([ 1, -1, 2, -2, 3, -3])

pytorch 还支持截取储存空间的一部分来作为一个新的 tensor 对象,基于内部的 storage_offset 与 size 属性,同样不需要复制:

# 截取向量的例子

>>> a = torch.tensor([1, 2, 3, -1, -2, -3])

>>> b = a[1:3]

>>> b

tensor([2, 3])

>>> b.storage_offset()

1

>>> b.size()

torch.Size([2])

>>> b.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

# 截取矩阵的例子

>>> a.view(3, 2)

tensor([[ 1, 2],

[ 3, -1],

[-2, -3]])

>>> c = a.view(3, 2)[1:] # 第一维度 (行) 截取 1~结尾, 第二维度不截取

>>> c

tensor([[ 3, -1],

[-2, -3]])

>>> c.storage_offset()

2

>>> c.size()

torch.Size([2, 2])

>>> c.stride()

(2, 1)

>>> c.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

# 截取转置后矩阵的例子,更复杂一些

>>> a.view(3, 2).transpose(0, 1)

tensor([[ 1, 3, -2],

[ 2, -1, -3]])

>>> c = a.view(3, 2).transpose(0, 1)[:,1:] # 第一维度 (行) 不截取,第二维度 (列) 截取 1~结尾

>>> c

tensor([[ 3, -2],

[-1, -3]])

>>> c.storage_offset()

2

>>> c.size()

torch.Size([2, 2])

>>> c.stride()

(1, 2)

>>> c.storage()

1

2

3

-1

-2

-3

[torch.LongStorage of size 6]

好了,看完这一节你应该对 pytorch 如何储存 tensor 对象有一个比较基础的了解。为了容易理解本节最多只使用二维矩阵做例子,你可以自己试试更多维度的矩阵是否可以用同样的方式操作。

矩阵乘法简介

接下来我们看看矩阵乘法 (Matrix Multiplication),这是机器学习中最最最频繁的操作,高中学过并且还记得的就当复习一下吧,

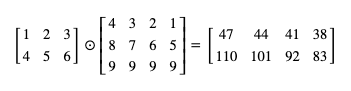

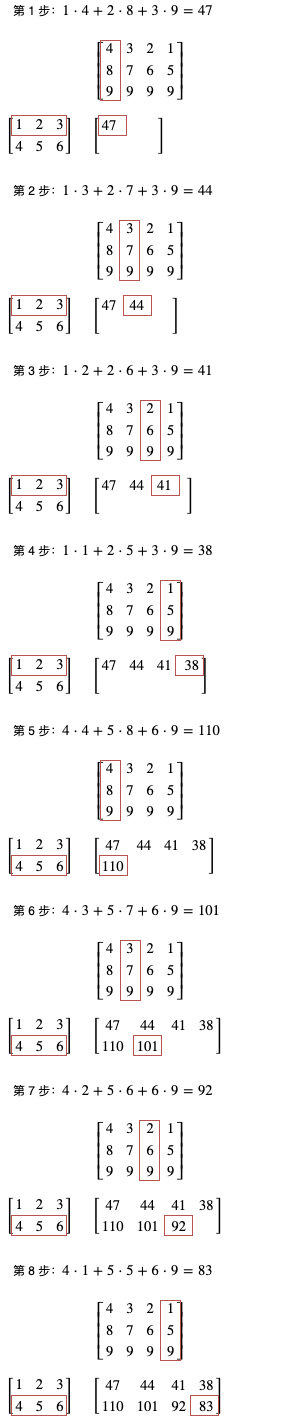

以下是一个简单的例子,一个 2 行 3 列的矩阵乘以一个 3 行 4 列的矩阵可以得出一个 2 行 4 列的矩阵:

矩阵乘法会把第一个矩阵的每一行与第二个矩阵的每一列相乘的各个合计值作为结果,可以参考下图理解:

按这个规则来算,一个 n 行 m 列的矩阵和一个 m 行 p 列的矩阵相乘,会得出一个 n 行 p 列的矩阵 (第一个矩阵的列数与第二个矩阵的行数必须相同)。

那矩阵乘法有什么意义呢?矩阵乘法在机器学习中的意义是可以把对多个输入输出或者中间值的计算合并到一个操作中 (在数学上也可以大幅简化公式),框架可以在内部并列化计算,因为高端的 GPU 有几千个核心,把计算分布到几千个核心中可以大幅提升运算速度。在接下来的例子中也可以看到如何用矩阵乘法实现批次训练。

使用 pytorch 进行矩阵乘法计算

在 pytorch 中矩阵乘法可以调用 mm 函数:

>>> a = torch.tensor([[1,2,3],[4,5,6]])

>>> b = torch.tensor([[4,3,2,1],[8,7,6,5],[9,9,9,9]])

>>> a.mm(b)

tensor([[ 47, 44, 41, 38],

[110, 101, 92, 83]])

# 如果大小不匹配会出错

>>> a = torch.tensor([[1,2,3],[4,5,6]])

>>> b = torch.tensor([[4,3,2,1],[8,7,6,5]])

>>> a.mm(b)

Traceback (most recent call last):

File "<stdin>", line 1, in <module>

RuntimeError: size mismatch, m1: [2 x 3], m2: [2 x 4] at ../aten/src/TH/generic/THTensorMath.cpp:197

# mm 函数也可以用 @ 操作符代替,结果是一样的

>>> a = torch.tensor([[1,2,3],[4,5,6]])

>>> b = torch.tensor([[4,3,2,1],[8,7,6,5],[9,9,9,9]])

>>> a @ b

tensor([[ 47, 44, 41, 38],

[110, 101, 92, 83]])

针对更多维度的矩阵乘法,pytorch 提供了 matmul 函数:

# n x m 的矩阵与 q x m x p 的矩阵相乘会得出 q x n x p 的矩阵

>>> a = torch.ones(2,3)

>>> b = torch.ones(5,3,4)

>>> a.matmul(b)

tensor([[[3., 3., 3., 3.],

[3., 3., 3., 3.]],

[[3., 3., 3., 3.],

[3., 3., 3., 3.]],

[[3., 3., 3., 3.],

[3., 3., 3., 3.]],

[[3., 3., 3., 3.],

[3., 3., 3., 3.]],

[[3., 3., 3., 3.],

[3., 3., 3., 3.]]])

>>> a.matmul(b).shape

torch.Size([5, 2, 4])

pytorch 的自动微分功能 (autograd)

pytorch 支持自动微分求导函数值 (即各个参数的梯度),利用这个功能我们不再需要通过数学公式求各个参数的导函数值,使得机器学习的门槛低了很多😄😄,以下是这个功能的例子:

# 定义参数

# 创建 tensor 对象时设置 requires_grad 为 True 即可开启自动微分功能

>>> w = torch.tensor(1.0, requires_grad=True)

>>> b = torch.tensor(0.0, requires_grad=True)

# 定义输入和输出的 tensor

>>> x = torch.tensor(2)

>>> y = torch.tensor(5)

# 计算预测输出

>>> p = x * w + b

>>> p

tensor(2., grad_fn=<AddBackward0>)

# 计算损失

# 注意 pytorch 的自动微分功能要求损失不能为负数,因为 pytorch 只会考虑减少损失而不是让损失接近 0

# 这里用 abs 让损失变为绝对值

>>> l = (p - y).abs()

>>> l

tensor(3., grad_fn=<AbsBackward>)

# 从损失自动微分求导函数值

>>> l.backward()

# 查看各个参数对应的导函数值

# 注意 pytorch 会假设让参数减去 grad 的值才能减少损失,所以这里是负数(参数会变大)

>>> w.grad

tensor(-2.)

>>> b.grad

tensor(-1.)

# 定义学习比率,即每次根据导函数值调整参数的比率

>>> learning_rate = 0.01

# 调整参数时需要用 torch.no_grad 来临时禁止自动微分功能

>>> with torch.no_grad():

... w -= w.grad * learning_rate

... b -= b.grad * learning_rate

...

# 我们可以看到 weight 和 bias 分别增加了 0.02 和 0.01

>>> w

tensor(1.0200, requires_grad=True)

>>> b

tensor(0.0100, requires_grad=True)

# 最后我们需要清空参数的 grad 值,这个值不会自动清零(因为某些模型需要叠加导函数值)

# 你可以试试再调一次 backward,会发现 grad 把两次的值叠加起来

>>> w.grad.zero_()

>>> b.grad.zero_()

我们再来试试前一节提到的让损失等于相差值平方的方法:

# 定义参数

>>> w = torch.tensor(1.0, requires_grad=True)

>>> b = torch.tensor(0.0, requires_grad=True)

# 定义输入和输出的 tensor

>>> x = torch.tensor(2)

>>> y = torch.tensor(5)

# 计算预测输出

>>> p = x * w + b

>>> p

tensor(2., grad_fn=<AddBackward0>)

# 计算相差值

>>> d = p - y

>>> d

tensor(-3., grad_fn=<SubBackward0>)

# 计算损失 (相差值的平方, 一定会是 0 或者正数)

>>> l = d ** 2

>>> l

tensor(9., grad_fn=<PowBackward0>)

# 从损失自动微分求导函数值

>>> l.backward()

# 查看各个参数对应的导函数值,跟我们上一篇用数学公式求出来的值一样吧

# w 的导函数值 = 2 * d * x = 2 * -3 * 2 = -12

# b 的导函数值 = 2 * d = 2 * -3 = -6

>>> w.grad

tensor(-12.)

>>> b.grad

tensor(-6.)

# 之后和上一个例子一样调整参数即可

腻害叭😼,再复杂的模型只要调用 backward 都可以自动帮我们计算出导函数值,从现在开始我们可以把数学课本丢掉了 (这是开玩笑的,一些问题仍然需要用数学来理解,但大部分情况下只有基础数学知识的人也能玩得起)。

如果您发现该资源为电子书等存在侵权的资源或对该资源描述不正确等,可点击“私信”按钮向作者进行反馈;如作者无回复可进行平台仲裁,我们会在第一时间进行处理!

- 最近热门资源

- 银河麒麟桌面操作系统备份用户数据 123

- 统信桌面专业版【全盘安装UOS系统】介绍 116

- 银河麒麟桌面操作系统安装佳能打印机驱动方法 108

- 银河麒麟桌面操作系统 V10-SP1用户密码修改 101