ML之LoR:逻辑回归LoR算法的简介、应用、经典案例之详细攻略

ML之LoR:逻辑回归LoR算法的简介、应用、经典案例之详细攻略

目录

逻辑回归LoR算法的简介

逻辑回归最适合二进制分类(y = 0或1的数据集,其中1表示默认类)。例如:在预测事件是否发生时,发生的事件被分类为1。在预测人会生病或不生病,生病的实例记为1)。它是以其中使用的变换函数命名的,称为逻辑函数h(x) =1 / (1+e-x),它是一个S形曲线。

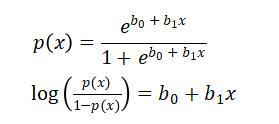

在逻辑回归中,输出是以缺省类别的概率形式出现的。因为这是一个概率,所以输出在0-1的范围内。输出(y值)通过对数转换x值,使用对数函数h(x) = 1 /(1+e-x)来生成。然后应用一个阈值来强制这个概率进入二元分类。

上图判断了肿瘤是恶性还是良性。默认变量是y = 1(肿瘤=恶性);x变量可以是肿瘤的信息,例如肿瘤的尺寸。如图所示,逻辑函数将数据集的各种实例的x值转换成0到1的范围。如果概率超过阈值0.5(由水平线示出),则将肿瘤分类为恶性。

逻辑回归的目标是使用训练数据来找到系数b0和b1的值,以使预测结果与实际结果之间的误差最小化。这些系数是使用最大似然估计来计算的。

1、LOR算法在经过严密的数据预处理后效果会非常好

作为最简单的分类算法,LoR逻辑回归,依然是工业界、金融界主流的分类算法之一。但是,要想让LoR发挥其最大效果,还必须要有一套科学的、严密的数据预处理流程。

2、LoR模型的优缺点

| 模型 | 优势 | 劣势 |

| LoR | 简单直观:易于理解; 应用广:技术成熟且稳定; 可解释住强:系数表示该特征的权重大小;变量系数可以与业内知识做交叉验证,更容易让人信服; 易于检测和部署:易于发现问题。当模型效果衰减的时候,LoR模型能更好的查找原因; | 不适用于非线性问题 相比较于DNN、XGboost,LoR准确度不高 |

逻辑回归LoR算法的应用

1、逻辑回归可视化

逻辑回归LoR算法的经典案例

TF之LoR:基于tensorflow利用逻辑回归算LoR法实现手写数字图片识别提高准确率

ML之LoR:LoR之二分类之线性决策算法实现根据两课成绩分数~预测期末通过率(合格还是不合格)

ML之LoR:利用LoR二分类之非线性决策算法案例应用之划分正负样本

网站声明:如果转载,请联系本站管理员。否则一切后果自行承担。

- 上周热门

- 银河麒麟添加网络打印机时,出现“client-error-not-possible”错误提示 1447

- 银河麒麟打印带有图像的文档时出错 1364

- 银河麒麟添加打印机时,出现“server-error-internal-error” 1150

- 统信桌面专业版【如何查询系统安装时间】 1072

- 统信操作系统各版本介绍 1069

- 统信桌面专业版【全盘安装UOS系统】介绍 1027

- 麒麟系统也能完整体验微信啦! 984

- 统信【启动盘制作工具】使用介绍 626

- 统信桌面专业版【一个U盘做多个系统启动盘】的方法 574

- 信刻全自动档案蓝光光盘检测一体机 483

- 本周热议

- 我的信创开放社区兼职赚钱历程 40

- 今天你签到了吗? 27

- 信创开放社区邀请他人注册的具体步骤如下 15

- 如何玩转信创开放社区—从小白进阶到专家 15

- 方德桌面操作系统 14

- 我有15积分有什么用? 13

- 用抖音玩法闯信创开放社区——用平台宣传企业产品服务 13

- 如何让你先人一步获得悬赏问题信息?(创作者必看) 12

- 2024中国信创产业发展大会暨中国信息科技创新与应用博览会 9

- 中央国家机关政府采购中心:应当将CPU、操作系统符合安全可靠测评要求纳入采购需求 8