TF之DNN:利用DNN【784→500→10】对MNIST手写数字图片识别数据集(TF自带函数下载)预测(98%)+案例理解DNN过程

TF之DNN:利用DNN【784→500→10】对MNIST手写数字图片识别数据集(TF自带函数下载)预测(98%)+案例理解DNN过程

目录

输出结果

案例理解DNN过程思路

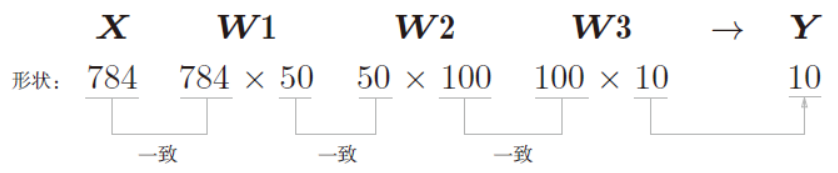

1、一张图像数组形状的变化:输入一个由784 个元素(28*28的二维数组)构成的一维数组后,输出一个有10个元素的一维数组。这是只输入一张图像数据时的处理流程。

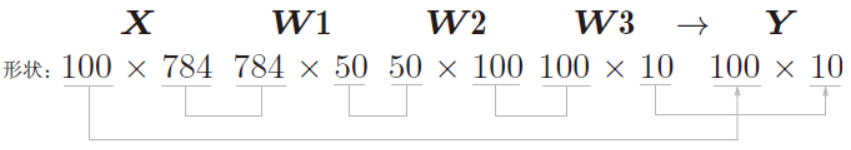

2、批处理中数组形状的变化:考虑打包输入多张图像的情形。比如,我们想用predict()函数一次性打包处理100张图像。为此,可以把x的形状改为100 × 784,将100 张图像打包作为输入数据。,输入数据的形状为100 × 784,输出数据的形状为

100 × 10。这表示输入的100 张图像的结果被一次性输出了。比如,x[0]和y[0]中保存了第0 张图像及其推理结果,x[1]和y[1]中保存了第1 张图像及其推理结果,等等。这种打包式的输入数据称为批(batch)。批有“捆”的意思,图像就如同纸币一样扎成一捆。

代码设计

- -*- coding: utf-8 -*-

-

- 实现的神经网络共有三层,输入层有 784 个神经元,隐藏层与输出层分别有 500 和 10 个神经元。这所以这样设计是因为 MNIST 的像素为 28×28=784,所以每一个输入神经元对应于一个灰度像素点。批量大小为 100并使用学习率衰减的情况下迭代 10000 步能得到 98.34% 的测试集准确度,

- import tensorflow as tf

- from tensorflow.examples.tutorials.mnist import input_data

-

-

- 加载MNIST数据集

- mnist = input_data.read_data_sets("./data/MNIST/", one_hot=True)

- INPUT_NODE = 784

- OUTPUT_NODE = 10

- LAYER1_NODE = 500

- BATCH_SIZE = 100

-

- 模型相关的参数

- LEARNING_RATE_BASE = 0.8

- LEARNING_RATE_DECAY = 0.99

- REGULARAZTION_RATE = 0.0001

- TRAINING_STEPS = 10000

- MOVING_AVERAGE_DECAY = 0.99

-

- def inference(input_tensor, avg_class, weights1, biases1, weights2, biases2):

- 使用滑动平均类

- if avg_class == None:

- layer1 = tf.nn.relu(tf.matmul(input_tensor, weights1) + biases1)

- return tf.matmul(layer1, weights2) + biases2

- else:

- layer1 = tf.nn.relu(tf.matmul(input_tensor, avg_class.average(weights1)) + avg_class.average(biases1))

- return tf.matmul(layer1, avg_class.average(weights2)) + avg_class.average(biases2)

- def train(mnist):

- x = tf.placeholder(tf.float32, [None, INPUT_NODE], name='x-input')

- y_ = tf.placeholder(tf.float32, [None, OUTPUT_NODE], name='y-input')

- 生成隐藏层的参数。

- weights1 = tf.Variable(tf.truncated_normal([INPUT_NODE, LAYER1_NODE], stddev=0.1))

- biases1 = tf.Variable(tf.constant(0.1, shape=[LAYER1_NODE]))

- 生成输出层的参数。

- weights2 = tf.Variable(tf.truncated_normal([LAYER1_NODE, OUTPUT_NODE], stddev=0.1))

- biases2 = tf.Variable(tf.constant(0.1, shape=[OUTPUT_NODE]))

-

- 计算不含滑动平均类的前向传播结果

- y = inference(x, None, weights1, biases1, weights2, biases2)

- 定义训练轮数及相关的滑动平均类

- global_step = tf.Variable(0, trainable=False)

- variable_averages = tf.train.ExponentialMovingAverage(MOVING_AVERAGE_DECAY, global_step)

- variables_averages_op = variable_averages.apply(tf.trainable_variables())

- average_y = inference(x, variable_averages, weights1, biases1, weights2, biases2)

- 计算交叉熵及其平均值

- cross_entropy = tf.nn.sparse_softmax_cross_entropy_with_logits(logits=y, labels=tf.argmax(y_, 1))

- cross_entropy_mean = tf.reduce_mean(cross_entropy)

- 定义交叉熵损失函数加上正则项为模型损失函数

- regularizer = tf.contrib.layers.l2_regularizer(REGULARAZTION_RATE)

- regularaztion = regularizer(weights1) + regularizer(weights2)

- loss = cross_entropy_mean + regularaztion

- 设置指数衰减的学习率。

- learning_rate = tf.train.exponential_decay(

- LEARNING_RATE_BASE,

- global_step,

- mnist.train.num_examples / BATCH_SIZE,

- LEARNING_RATE_DECAY,

- staircase=True)

- 随机梯度下降优化器优化损失函数,使用梯度下降优化器来优化权重。然而,TensorFlow 中还有很多优化器,最常用的是 GradientDescentOptimizer、AdamOptimizer 和 AdaGradOptimizer。

- train_step = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss, global_step=global_step)

- 反向传播更新参数和更新每一个参数的滑动平均值

- with tf.control_dependencies([train_step, variables_averages_op]):

- train_op = tf.no_op(name='train')

- 计算准确度

- correct_prediction = tf.equal(tf.argmax(average_y, 1), tf.argmax(y_, 1))

- accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

- 初始化会话并开始训练过程。

- with tf.Session() as sess:

- tf.global_variables_initializer().run()

- validate_feed = {x: mnist.validation.images, y_: mnist.validation.labels}

- test_feed = {x: mnist.test.images, y_: mnist.test.labels}

- 循环地训练神经网络。

- for i in range(TRAINING_STEPS):

- if i % 1000 == 0:

- validate_acc = sess.run(accuracy, feed_dict=validate_feed)

- print("After %d training step(s), validation accuracy using average model is %g " % (i, validate_acc))

- xs,ys=mnist.train.next_batch(BATCH_SIZE)

- sess.run(train_op,feed_dict={x:xs,y_:ys})

- test_acc=sess.run(accuracy,feed_dict=test_feed)

- print(("After %d training step(s), test accuracy using average model is %g" %(TRAINING_STEPS, test_acc)))

-

-

- avg_class = None

- train(mnist)

相关文章

TF之NN:(TF自带函数下载MNIST55000训练集图片)实现手写数字识别87.4%准确率识别:SGD法+softmax法+cross_entropy法

TF之DNN:(TF自带函数下载MNIST55000训练集图片)利用 784 个神经元的三层全连接的DNN对MNIST手写数字识别实现98%准确率

网站声明:如果转载,请联系本站管理员。否则一切后果自行承担。

赞同 0

评论 0 条

- 上周热门

- 如何使用 StarRocks 管理和优化数据湖中的数据? 2944

- 【软件正版化】软件正版化工作要点 2863

- 统信UOS试玩黑神话:悟空 2823

- 信刻光盘安全隔离与信息交换系统 2717

- 镜舟科技与中启乘数科技达成战略合作,共筑数据服务新生态 1251

- grub引导程序无法找到指定设备和分区 1217

- 华为全联接大会2024丨软通动力分论坛精彩议程抢先看! 163

- 点击报名 | 京东2025校招进校行程预告 162

- 2024海洋能源产业融合发展论坛暨博览会同期活动-海洋能源与数字化智能化论坛成功举办 160

- 华为纯血鸿蒙正式版9月底见!但Mate 70的内情还得接着挖... 157

- 本周热议

- 我的信创开放社区兼职赚钱历程 40

- 今天你签到了吗? 27

- 信创开放社区邀请他人注册的具体步骤如下 15

- 如何玩转信创开放社区—从小白进阶到专家 15

- 方德桌面操作系统 14

- 我有15积分有什么用? 13

- 用抖音玩法闯信创开放社区——用平台宣传企业产品服务 13

- 如何让你先人一步获得悬赏问题信息?(创作者必看) 12

- 2024中国信创产业发展大会暨中国信息科技创新与应用博览会 9

- 中央国家机关政府采购中心:应当将CPU、操作系统符合安全可靠测评要求纳入采购需求 8

热门标签更多