yyds!Python爬虫的完整学习框架

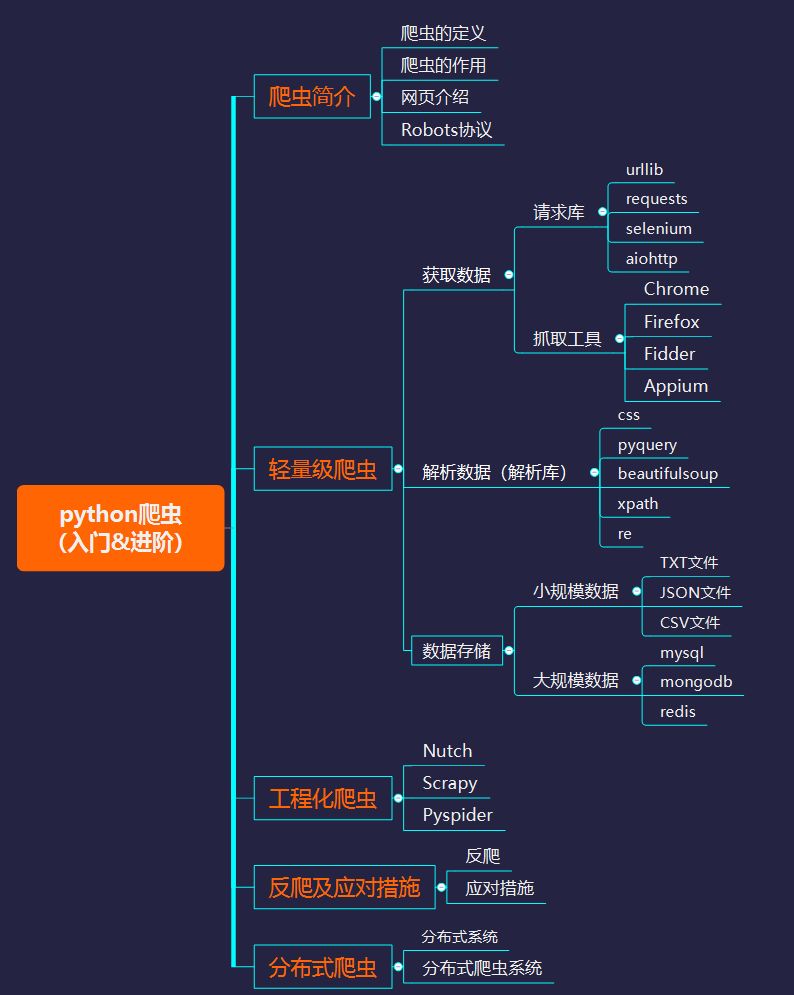

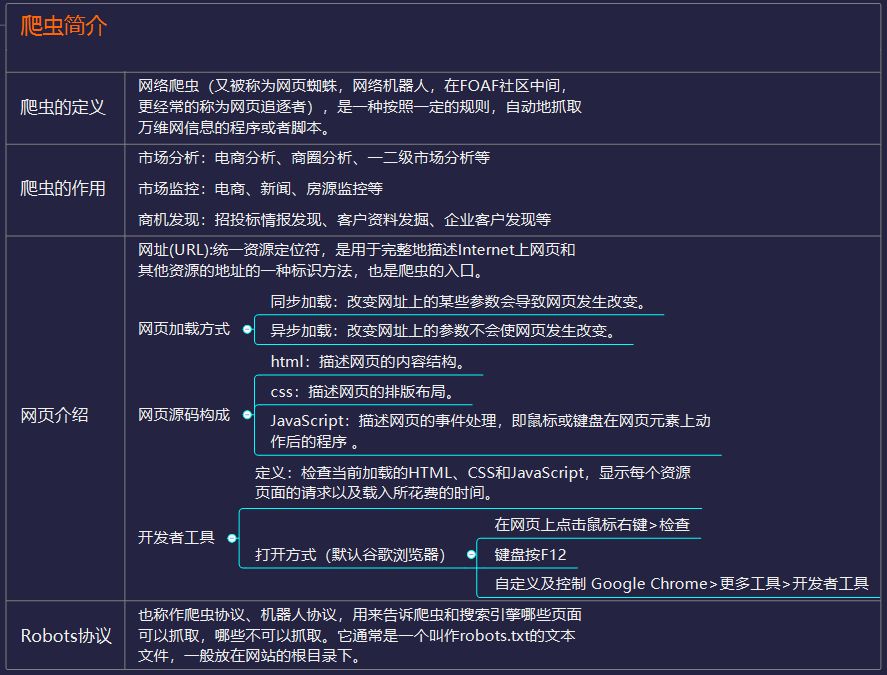

爬虫简介

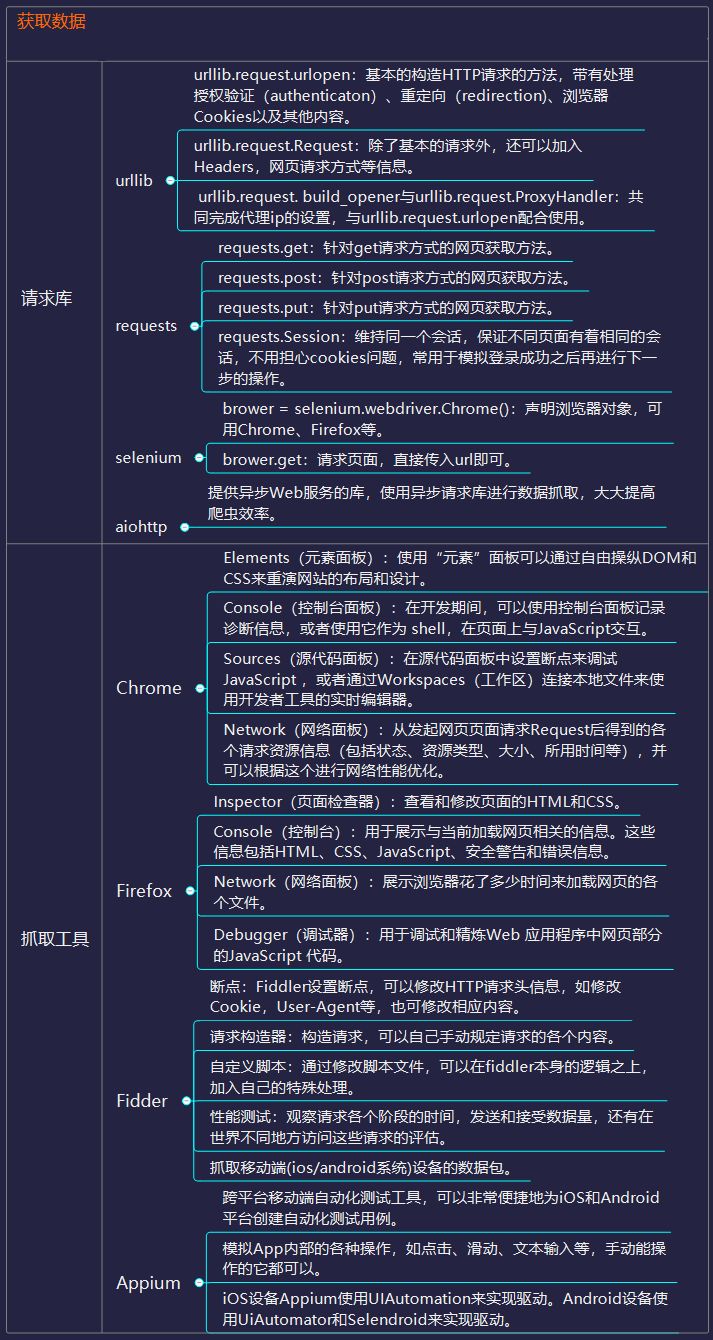

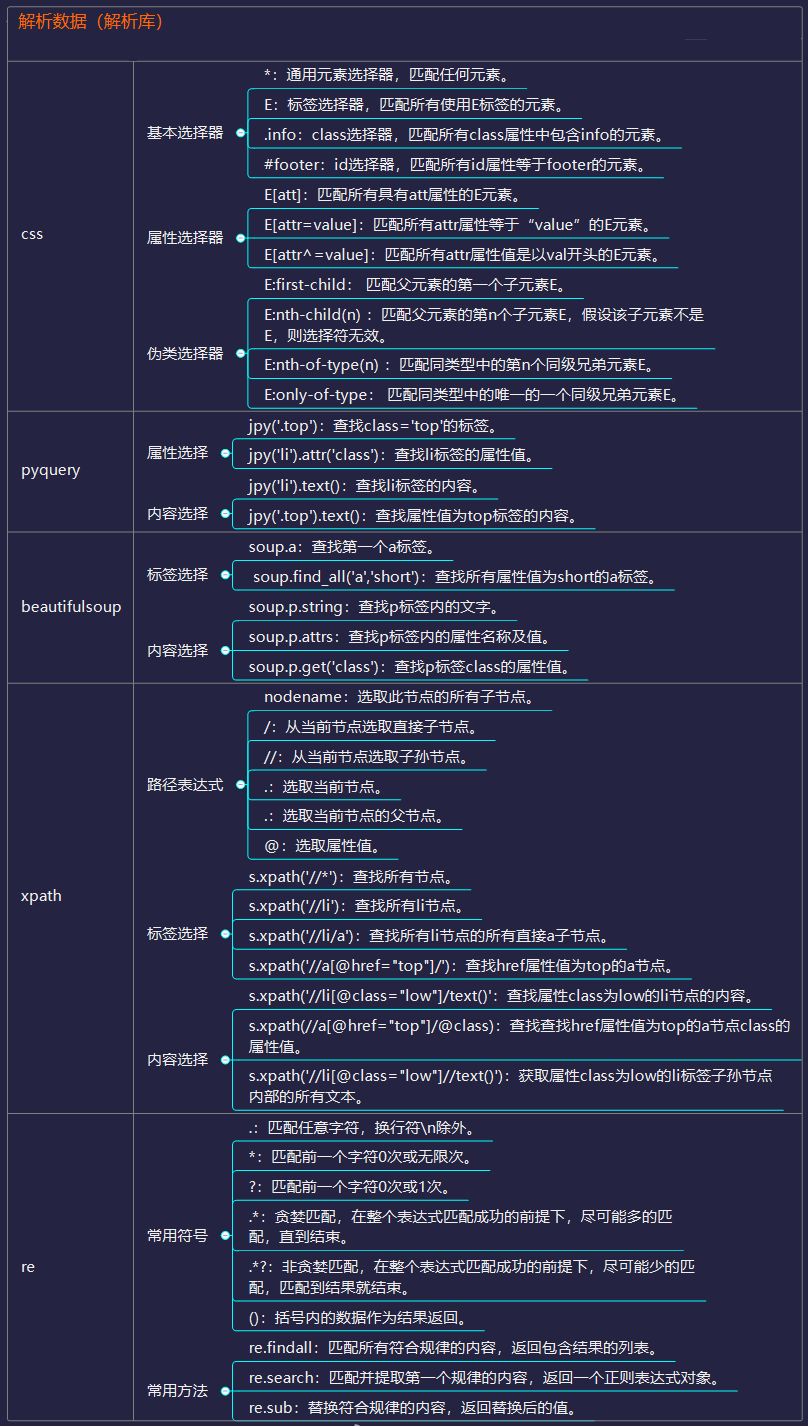

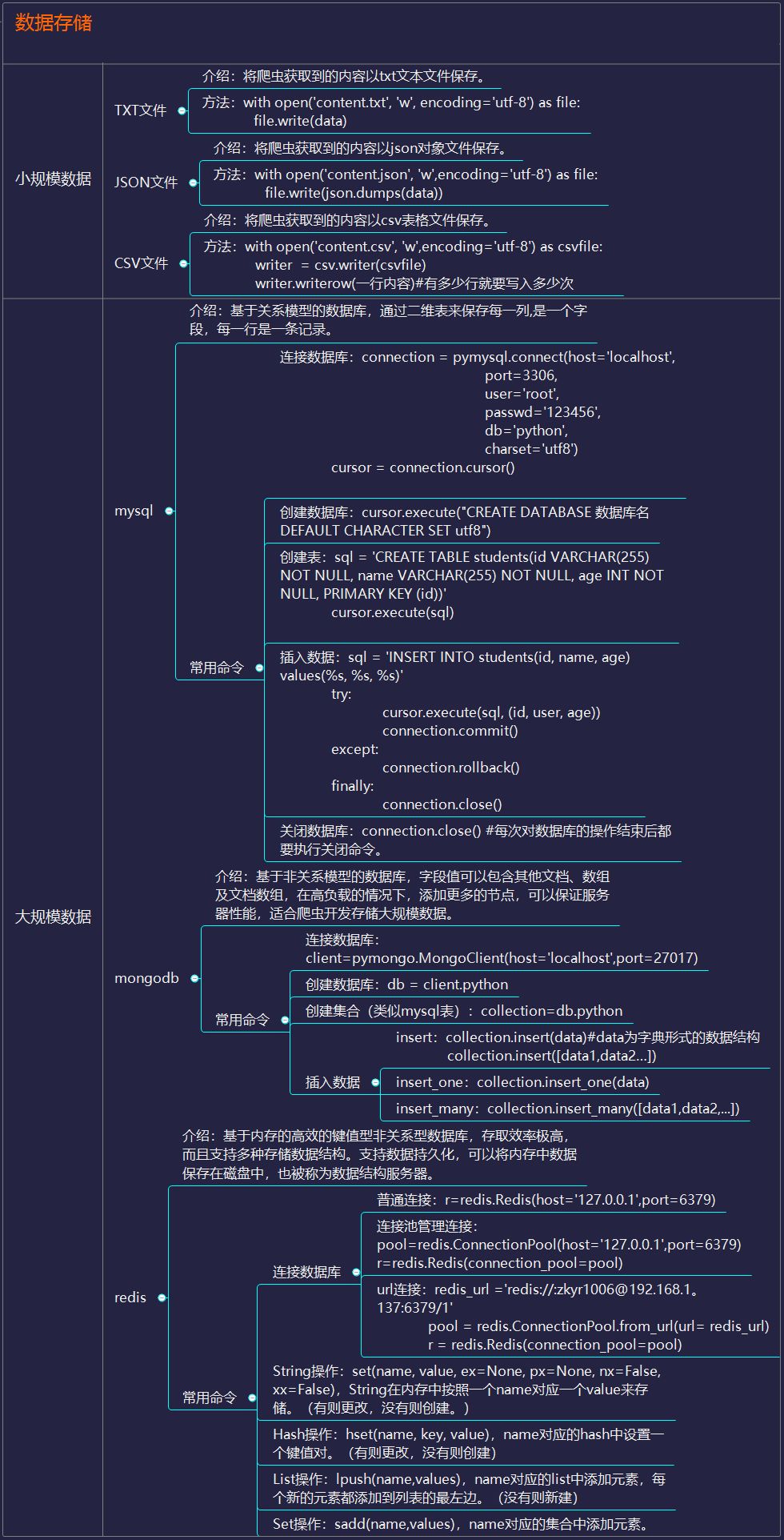

轻量级爬虫

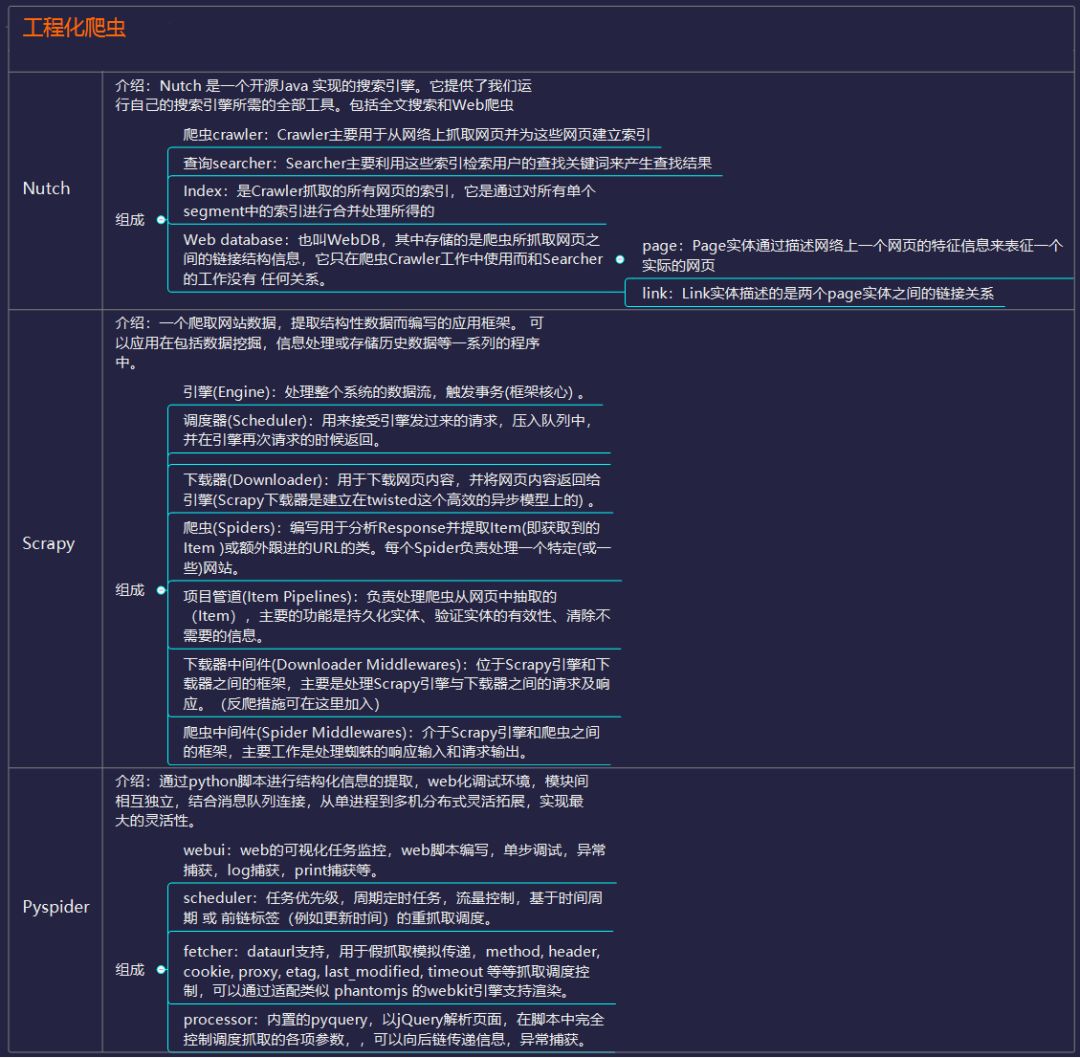

工程化爬虫

反爬及应对措施

分布式爬虫

网站声明:如果转载,请联系本站管理员。否则一切后果自行承担。

赞同 0

评论 0 条

- 上周热门

- 如何使用 StarRocks 管理和优化数据湖中的数据? 2962

- 【软件正版化】软件正版化工作要点 2881

- 统信UOS试玩黑神话:悟空 2848

- 信刻光盘安全隔离与信息交换系统 2740

- 镜舟科技与中启乘数科技达成战略合作,共筑数据服务新生态 1274

- grub引导程序无法找到指定设备和分区 1239

- 华为全联接大会2024丨软通动力分论坛精彩议程抢先看! 165

- 2024海洋能源产业融合发展论坛暨博览会同期活动-海洋能源与数字化智能化论坛成功举办 164

- 点击报名 | 京东2025校招进校行程预告 164

- 华为纯血鸿蒙正式版9月底见!但Mate 70的内情还得接着挖... 159

- 本周热议

- 我的信创开放社区兼职赚钱历程 40

- 今天你签到了吗? 27

- 信创开放社区邀请他人注册的具体步骤如下 15

- 如何玩转信创开放社区—从小白进阶到专家 15

- 方德桌面操作系统 14

- 我有15积分有什么用? 13

- 用抖音玩法闯信创开放社区——用平台宣传企业产品服务 13

- 如何让你先人一步获得悬赏问题信息?(创作者必看) 12

- 2024中国信创产业发展大会暨中国信息科技创新与应用博览会 9

- 中央国家机关政府采购中心:应当将CPU、操作系统符合安全可靠测评要求纳入采购需求 8

热门标签更多