k8s 基于 Ingress 实现 k8s 七层调度和负载均衡

-

如何在 k8s 中实现应用的负载均衡?

- 负载均衡是什么?

负载均衡是由多台服务器以对称的方式组成一个服务器集合,每台服务器都具有等价的地位,都可以单独对外提供服务而无需其他服务器的辅助。

通过某种负载分担技术,将外部发送来的请求按照某种策略分配到服务器集合的某一台服务器上,而接收到请求的服务器独立地回应客户的请求。

负载均衡解决了大量并发访问服务问题,其目的就是用最少的投资获得接近于大型主机的性能。

- 在接触 k8s 之前都了解哪些负载均衡方案?

四层负载均衡:lvs(软件层面)、f5(硬件层面)

缺点:对网络依赖较大,负载智能化方面没有 7 层负载好(比如不支持对 url 个性化负载),F5 硬件性能很高但成本也高,需要人民币几十万,对于小公司就望而却步了。

常见的七层负载均衡:nginx、apache

优点:对网络依赖少,负载智能方案多(比如可根据不同的 url 进行负载)

在 k8s 中为什么要做负载均衡?

Pod 漂移问题

Kubernetes 具有强大的副本控制能力,能保证在任意副本(Pod)挂掉时自动从其他机器启动一个新的,还可以动态扩容等。通俗地说,这个 Pod 可能在任何时刻出现在任何节点上,也可能在任何时刻死在任何节点上;那么自然随着 Pod 的创建和销毁,Pod IP 肯定会动态变化;那么如何把这个动态的Pod IP 暴露出去?这里借助于 Kubernetes 的 Service 机制,Service 可以以标签的形式选定一组带有指定标签的 Pod,并监控和自动负载他们的 Pod IP,那么我们向外暴露只暴露 Service IP 就行了;这就是 NodePort 模式:即在每个节点上开起一个端口,然后转发到内部 Pod IP 上。

-

使用 service 做四层负载均衡

- 在 kubernetes 中,Pod 是有生命周期的,如果 Pod 重启 IP 很有可能会发生变化。

如果我们的服务都是将 Pod 的 IP 地址写死,Pod 的挂掉或者重启,和刚才重启的 pod 相关联的其他服务将会找不到它所关联的 Pod

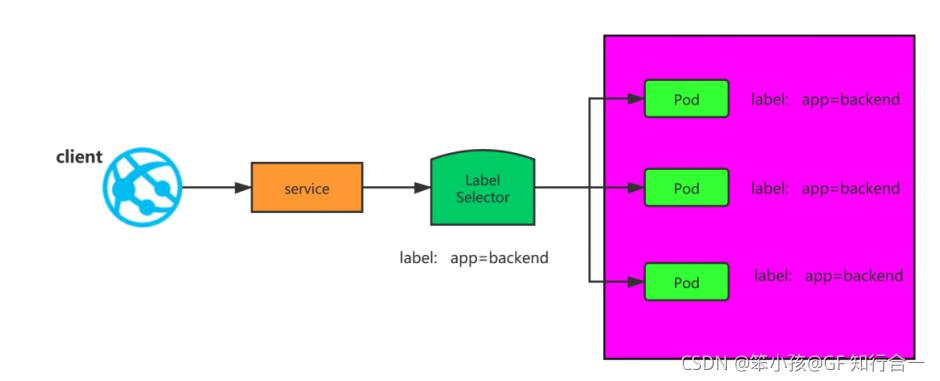

为了解决这个问题,在 kubernetes 中定义了 service 资源对象,Service 定义了一个服务访问的入口,客户端通过这个入口即可访问服务背后的应用集群实例,service 是一组 Pod 的逻辑集合,这一组 Pod 能够被 Service 访问到,通常是通过 Label Selector 实现的。

可以看下面的图:

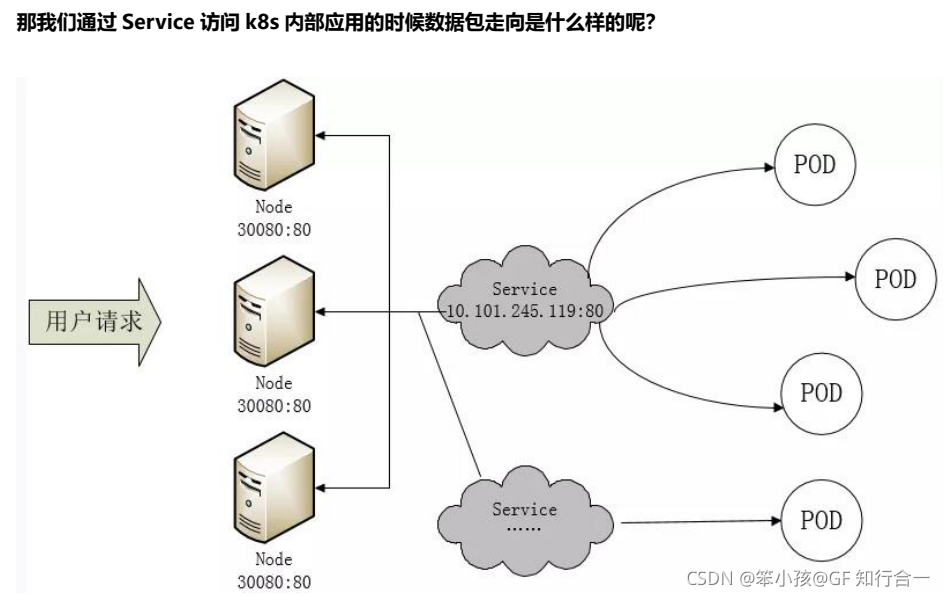

此时的数据包流向如下:

客户端请求-->node 节点的 ip:端口--->service 的 ip:端口--->pod 的 ip:端口 -

-

案例演示:

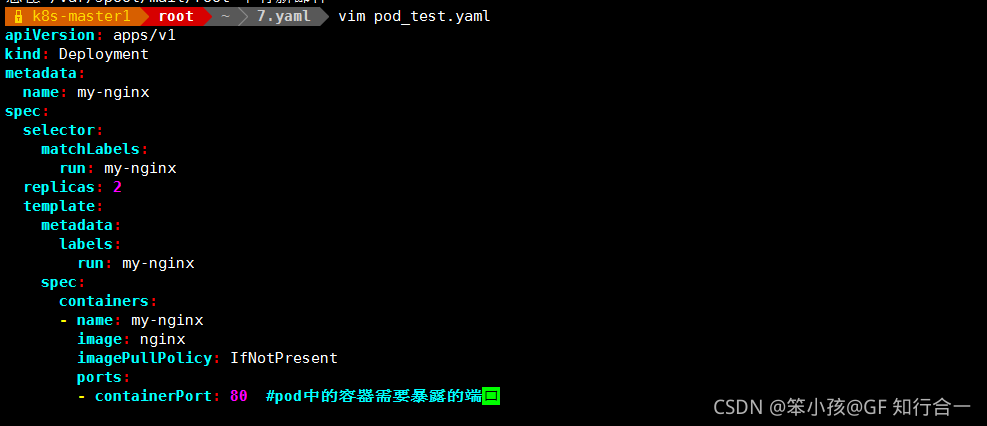

创建一个 k8s pod,通过 service 代理

vim pod_test.yaml

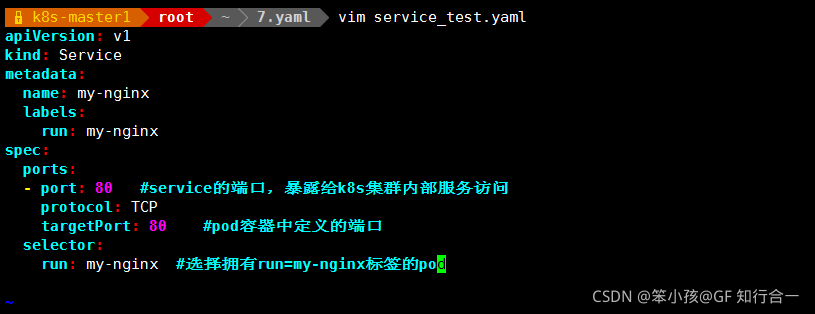

创建一个 service

vim service_test.yaml

端口管理问题

采用 service 的 NodePort 方式暴露服务面临的问题是,服务一旦多起来,NodePort 在每个节点上开启的端口会及其庞大,而且难以维护。 - 四层负载均衡和七层负载均衡对比分析

1)四层的负载均衡就是基于 IP+端口的负载均衡:在三层负载均衡的基础上,通过发布三层的 IP 地址(VIP),然后加四层的端口号,来决定哪些流量需要做负载均衡,对需要处理的流量进行 NAT 处理,转发至后台服务器,并记录下这个 TCP 或者 UDP 的流量是由哪台服务器处理的,后续这个连接的所有流量都同样转发到同一台服务器处理。

2)七层的负载均衡就是基于虚拟的 URL 或主机 IP 的负载均衡:在四层负载均衡的基础上(没有四层是绝对不可能有七层),再考虑应用层的特征,比如同一个 Web 服务器的负载均衡,除了根据 VIP加 80 端口辨别是否需要处理的流量,还可根据七层的 URL、浏览器类别、语言来决定是否要进行负载均衡。

举个例子,如果你的 Web 服务器分成两组,一组是中文语言的,一组是英文语言的,那么七层负载均衡就可以当用户来访问你的域名时,自动辨别用户语言,然后选择对应的语言服务器组进行负载均衡处理。

-

Ingress 和 Ingress Controller 深度解读

-

为什么要使用 k8s 原生的 Ingress controller 做七层负载均衡?

-

Ingress 介绍

Ingress 官网定义:Ingress 可以把进入到集群内部的请求转发到集群中的一些服务上,从而可以把服务映射到集群外部。

Ingress 能把集群内 Service 配置成外网能够访问的 URL,流量负载均衡,提供基于域名访问的虚拟主机等。

Ingress 简单的理解就是你原来需要改 Nginx 配置,然后配置各种域名对应哪个 Service,现在把这个动作抽象出来,变成一个 Ingress 对象,你可以用 yaml 创建,每次不要去改 Nginx 了,直接改yaml 然后创建/更新就行了; -

那么问题来了:”Nginx 该怎么处理?”

Ingress Controller 这东西就是解决 “Nginx 的处理方式” 的;

Ingress Controller 通过与Kubernetes API 交互,动态的去感知集群中 Ingress 规则变化,然后读取他,按照他自己模板生成一段 Nginx 配置,再写到 Ingress Controller Nginx 里,最后 reload 一下

工作流程如下图:

实际上 Ingress 也是 Kubernetes API 的标准资源类型之一,它其实就是一组基于 DNS 名称(host)或 URL 路径把请求转发到指定的 Service 资源的规则

用于将集群外部的请求流量转发到集群内部完成的服务发布。我们需要明白的是,Ingress 资源自身不能进行“流量穿透”,仅仅是一组规则的集合,这些集合规则还需要其他功能的辅助,比如监听某套接字,然后根据这些规则的匹配进行路由转发,这些能够为 Ingress 资源监听套接字并将流量转发的组件就是 Ingress Controller。

注:Ingress 控制器不同于 Deployment 控制器的是,Ingress 控制器不直接运行为 kubecontroller-manager 的一部分,它仅仅是 Kubernetes 集群的一个附件,类似于 CoreDNS,需要在集群上单独部署。

-

Ingress Controller 介绍

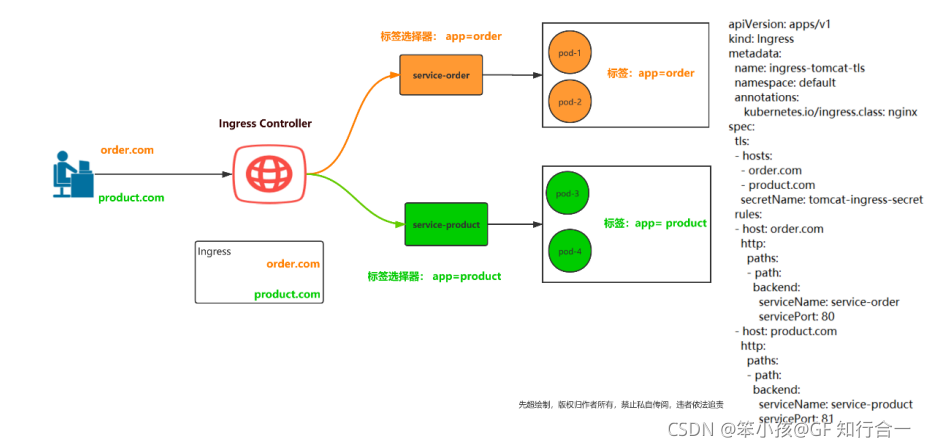

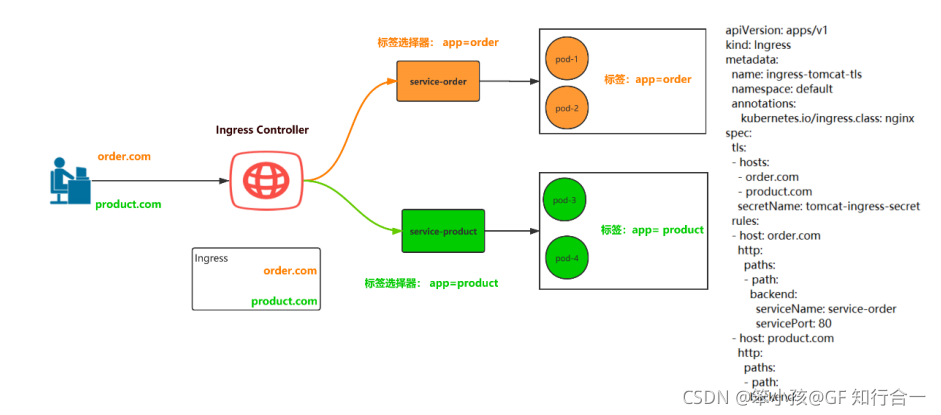

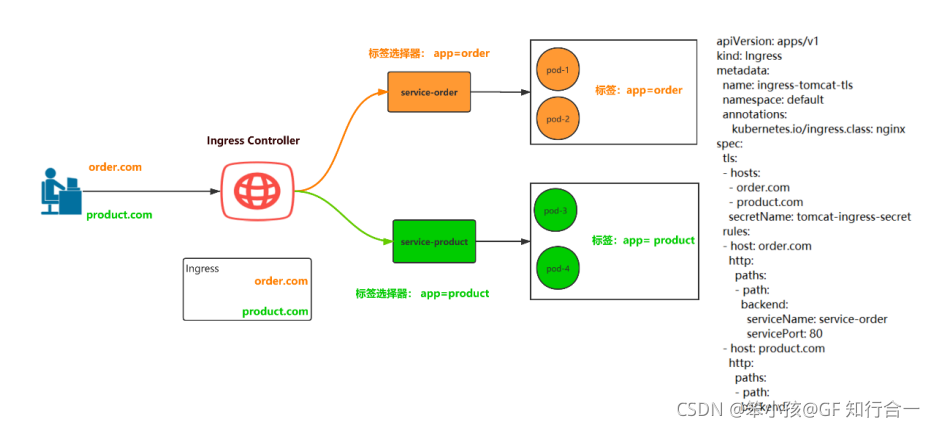

- Ingress Controller 是一个七层负载均衡调度器,客户端的请求先到达这个七层负载均衡调度器,由七层负载均衡器在反向代理到后端 pod,常见的七层负载均衡器有 nginx、traefik,以我们熟悉的nginx 为例,假如请求到达 nginx,会通过 upstream 反向代理到后端 pod 应用,但是后端 pod 的 ip 地址是一直在变化的,因此在后端 pod 前需要加一个 service,这个 service 只是起到分组的作用,那么我们 upstream 只需要填写 service 地址即可

-

Ingress 和 Ingress Controller 总结

Ingress Controller 可以理解为控制器,它通过不断的跟 Kubernetes API 交互,实时获取后端Service、Pod 的变化,比如新增、删除等,结合 Ingress 定义的规则生成配置,然后动态更新上边的Nginx 或者 trafik 负载均衡器,并刷新使配置生效,来达到服务自动发现的作用。

Ingress 则是定义规则,通过它定义某个域名的请求过来之后转发到集群中指定的 Service。它可以通过 Yaml 文件定义,可以给一个或多个 Service 定义一个或多个 Ingress 规则。

-

使用 Ingress Controller 代理 k8s 内部应用的流程

(1)部署 Ingress controller,我们 ingress controller 使用的是 nginx

(2)创建 Pod 应用,可以通过控制器创建 pod

(3)创建 Service,用来分组 pod

(4)创建 Ingress http,测试通过 http 访问应用

(5)创建 Ingress https,测试通过 https 访问应用

客户端通过七层调度器访问后端 pod 的方式

使用七层负载均衡调度器 ingress controller 时,当客户端访问 kubernetes 集群内部的应用时,数据包走向如下图流程所示:

-

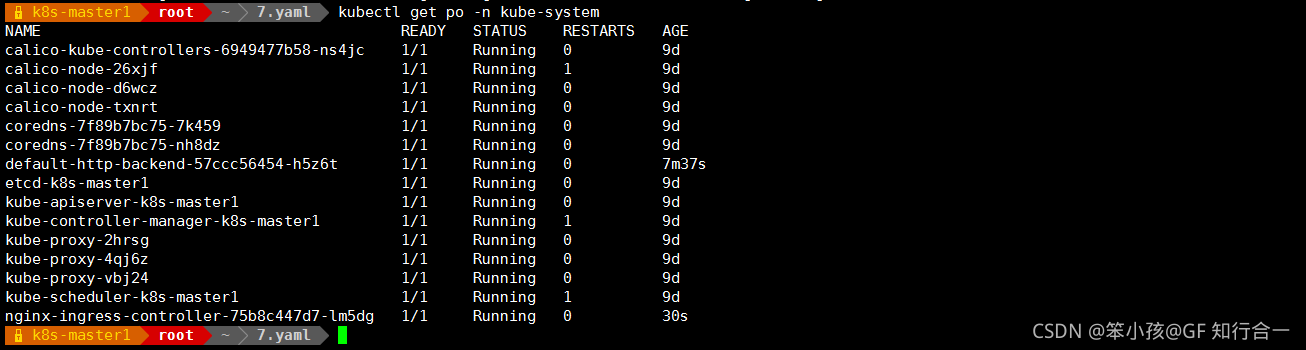

安装 Nginx Ingress Controller

-

-

需要的 yaml 所在的 github 地址:

https://github.com/kubernetes/ingress-nginx/

default-backend.yaml

nginx-ingress-controller.yaml

nginx-ingress-controller-rbac.yml

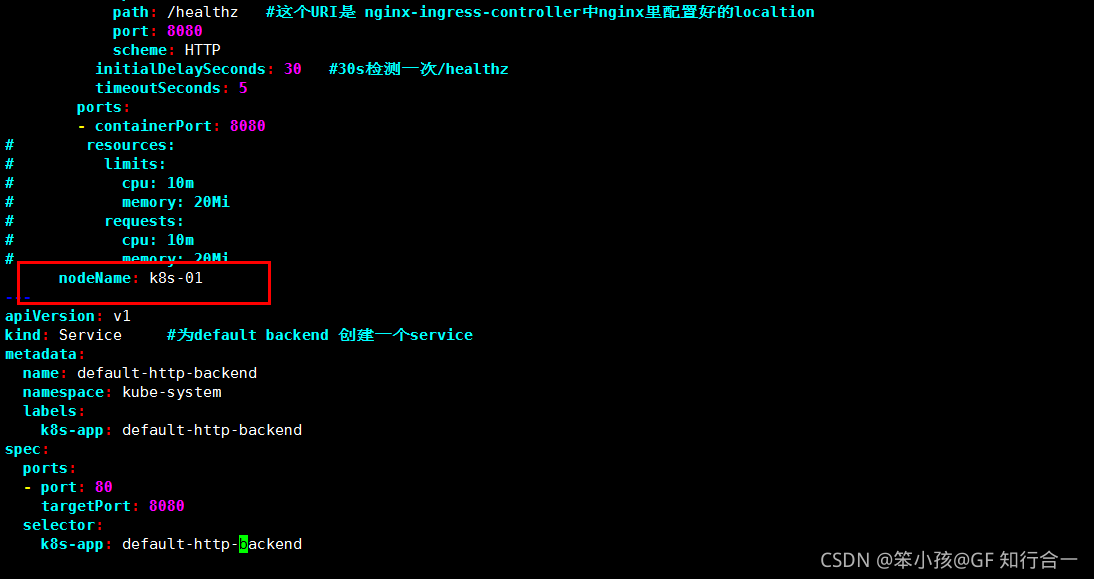

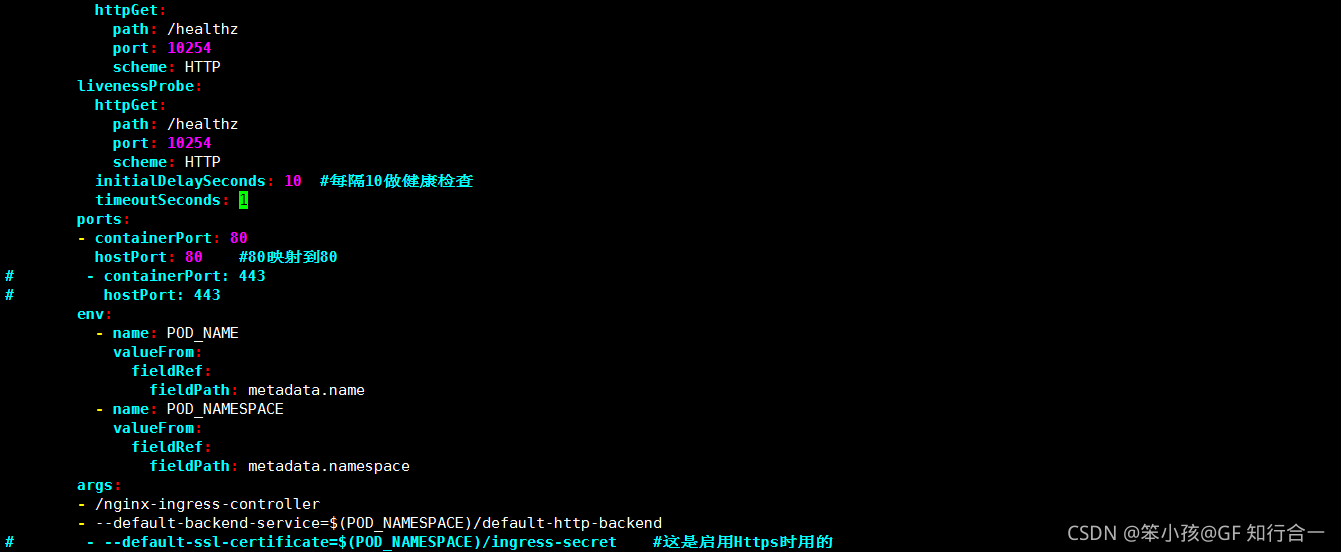

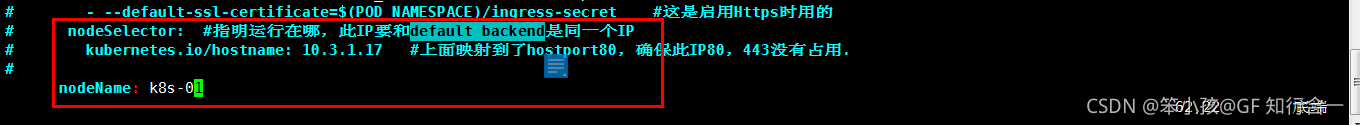

需要修改 nodeName:

需要修改 nodeName:

注意:

注意:

default-backend.yaml 和 nginx-ingress-controller.yaml 文件指定了 nodeName:k8s-01,表示 default 和 nginx-ingress-controller 部署在 k8s-01 节点,需要自行修改成自己的主机名,这样才会调度成功,让 default-http-backend 和 nginx-ingress-controller 这两个 pod 在一个节点上。

default-backend.yaml:这是官方要求必须要给的默认后端,提供 404 页面。它还提供了一个http 检测功能,检测 nginx-ingress-controll 健康状态的,通过每隔一定时间访问 nginx-ingresscontroll 的/healthz 页面,如是没有响应就返回 404 之类的错误码。 -

测试 Ingress HTTP 代理 k8s 内部站点

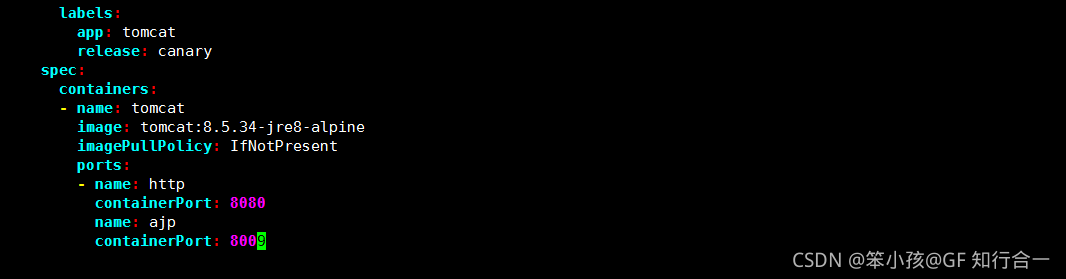

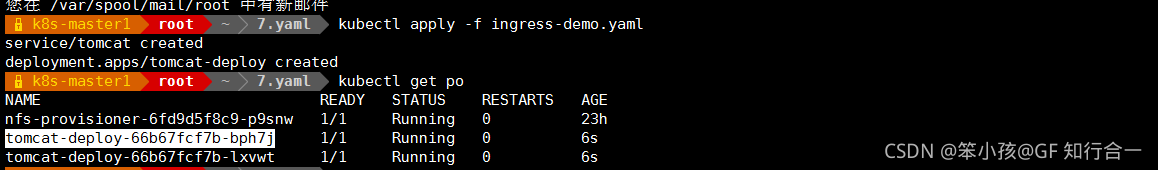

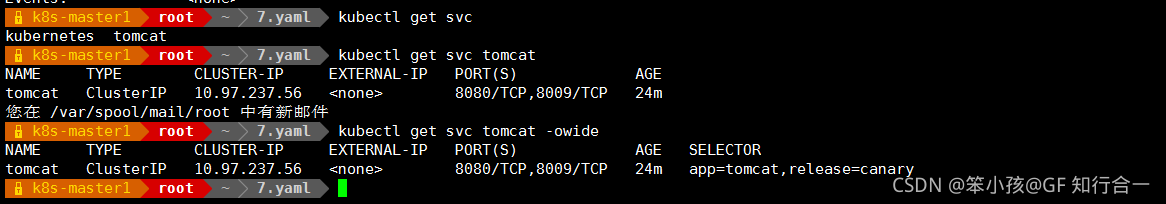

- 部署后端 tomcat 服务

vim ingress-demo.yaml

-

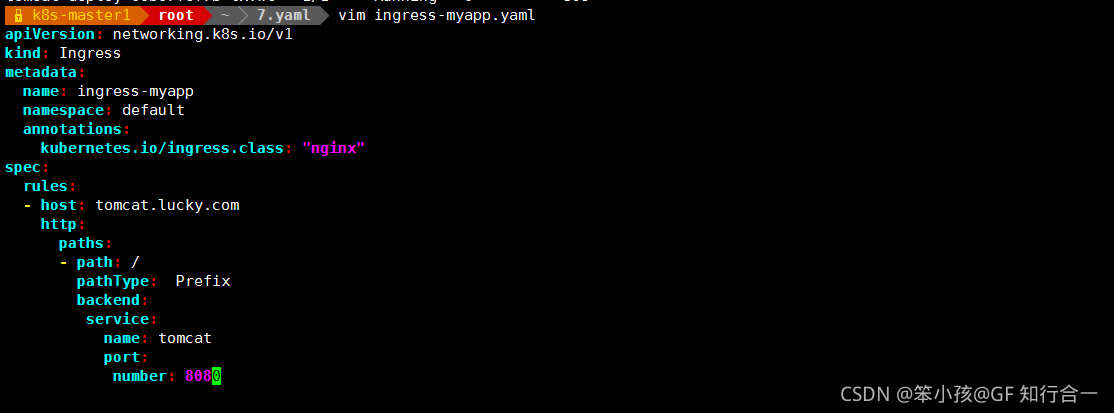

编写 ingress 规则

编写 ingress 的配置清单

cat ingress-myapp.yaml

rules: 定义后端转发的规则

- host: tomcat.lucky.com 通过域名进行转发

http:

paths:

- path: / 配置访问路径,如果通过 url 进行转发,需要修改;空默认为访问的路径为"/"

pathType: Prefix

backend: 配置后端服务

service:

name: tomcat

port:

number: 8080

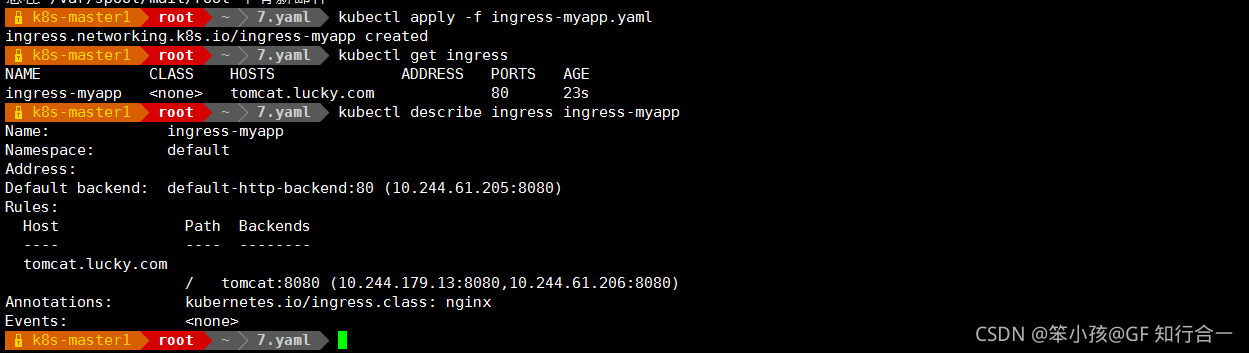

修改电脑本地的 host 文件,增加如下一行,下面的 ip 是 k8s-01 节点 ip

192.168.2.40 tomcat.lucky.com

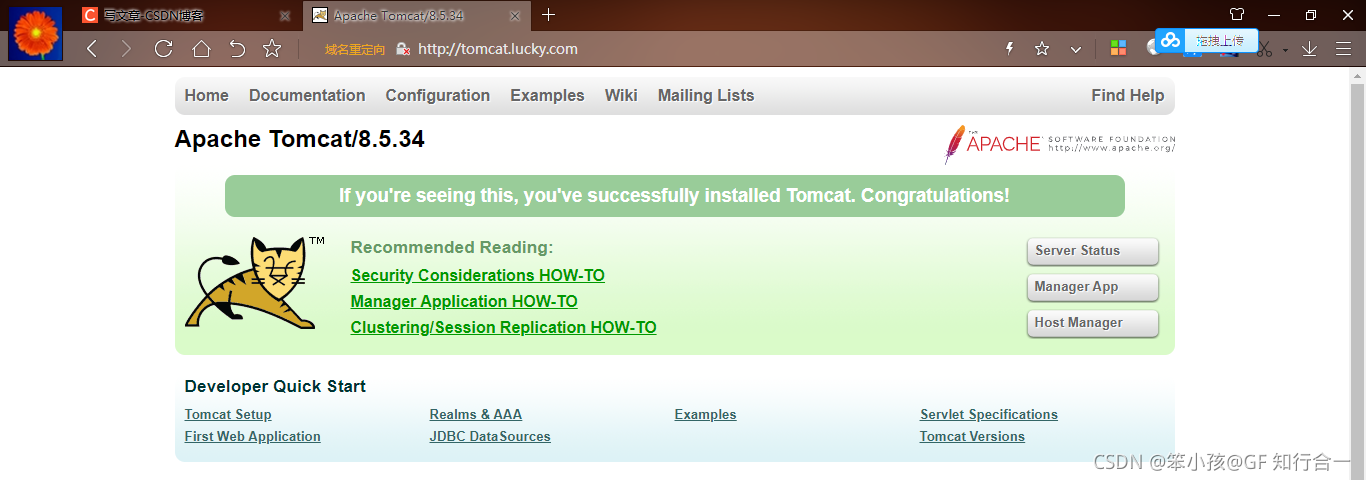

浏览器访问 tomcat.lucky.com,出现如下:

-

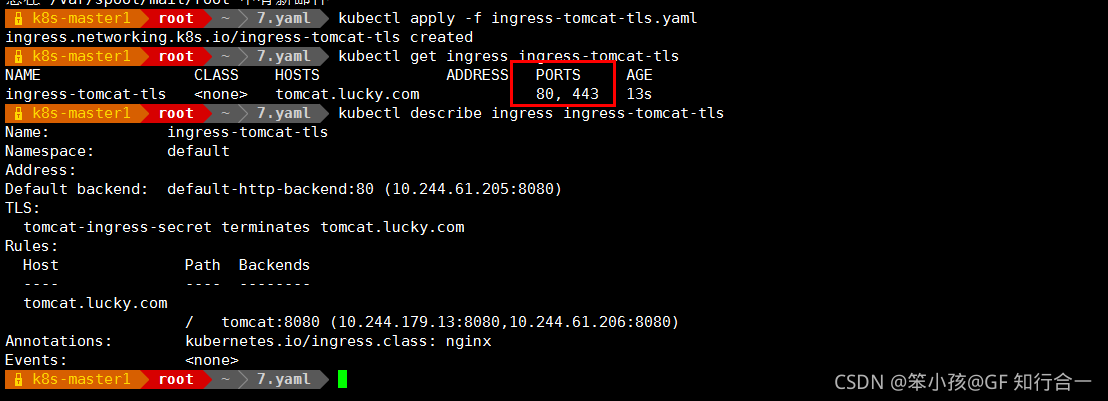

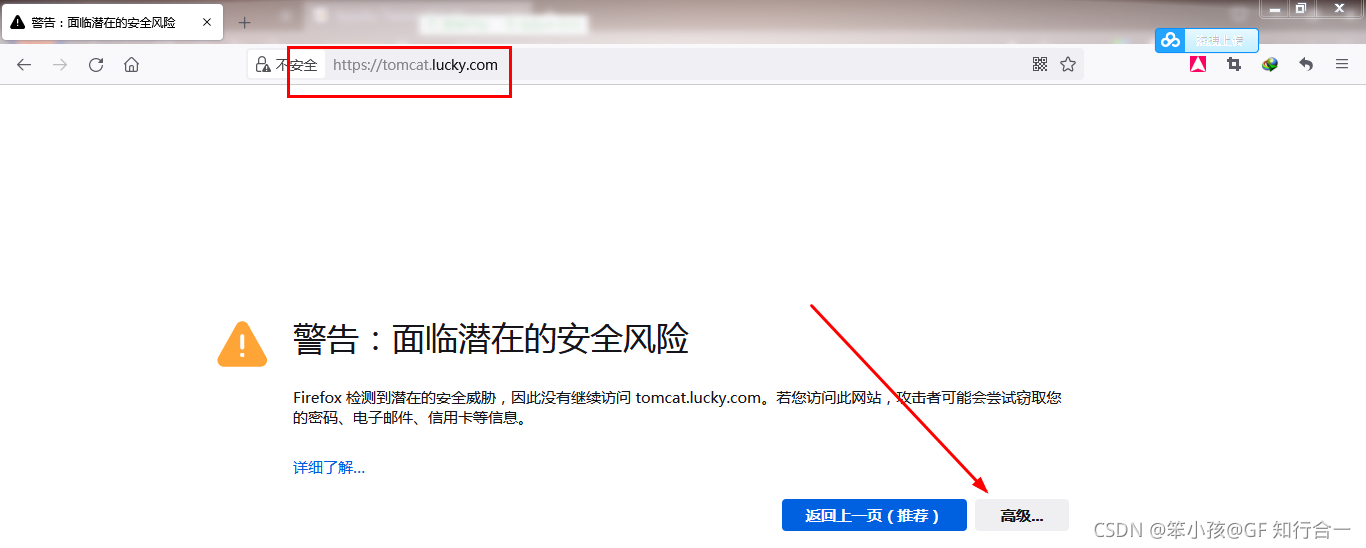

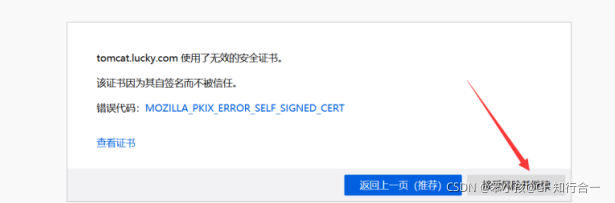

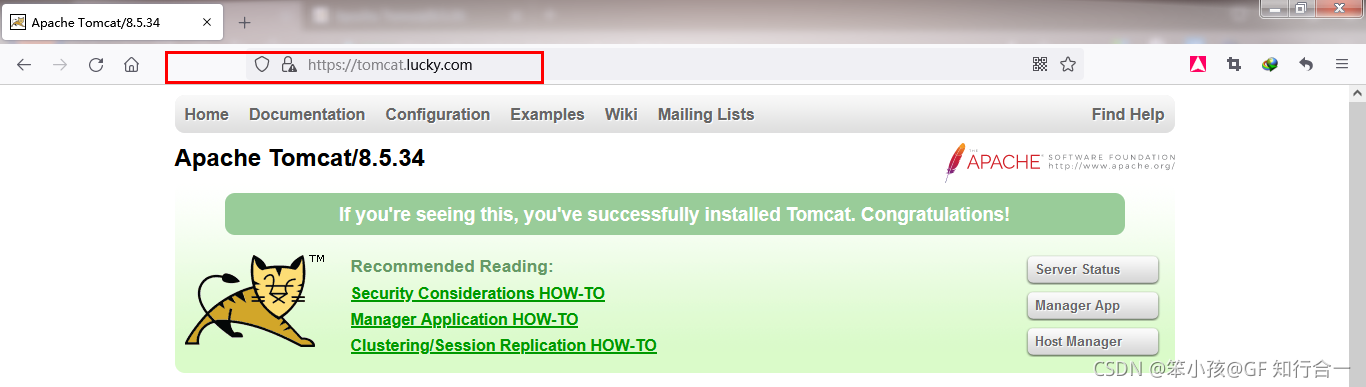

测试 Ingress HTTPS 代理 tomcat

1、构建 TLS 站点

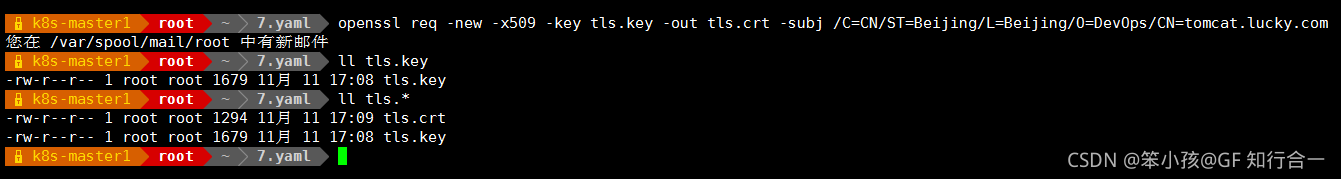

(1)准备证书,在 master1 节点操作

openssl genrsa -out tls.key 2048

openssl req -new -x509 -key tls.key -out tls.crt -subj /C=CN/ST=Beijing/L=Beijing/O=DevOps/CN=tomcat.lucky.com

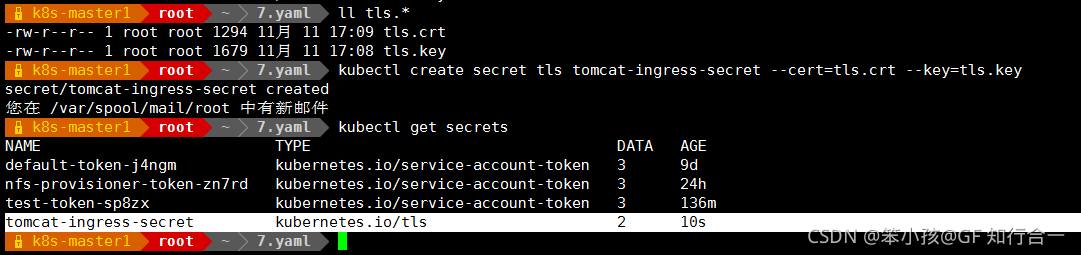

(2)生成 secret,在 master1 节点操作

kubectl create secret tls tomcat-ingress-secret --cert=tls.crt --key=tls.key

(3)查看 secret

kubectl get secret

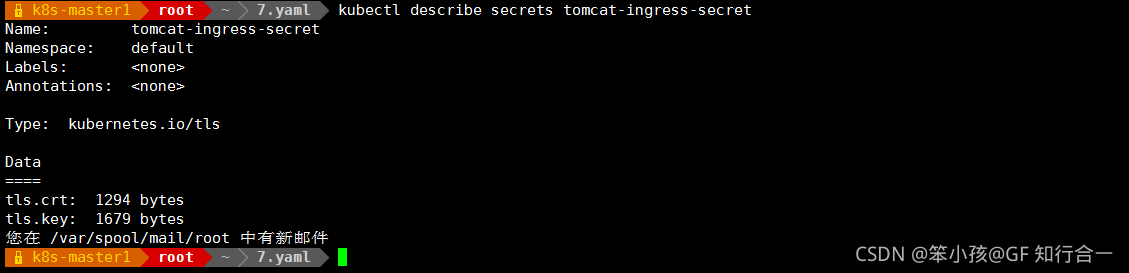

(4)查看 tomcat-ingress-secret 详细信息

kubectl describe secret tomcat-ingress-secret

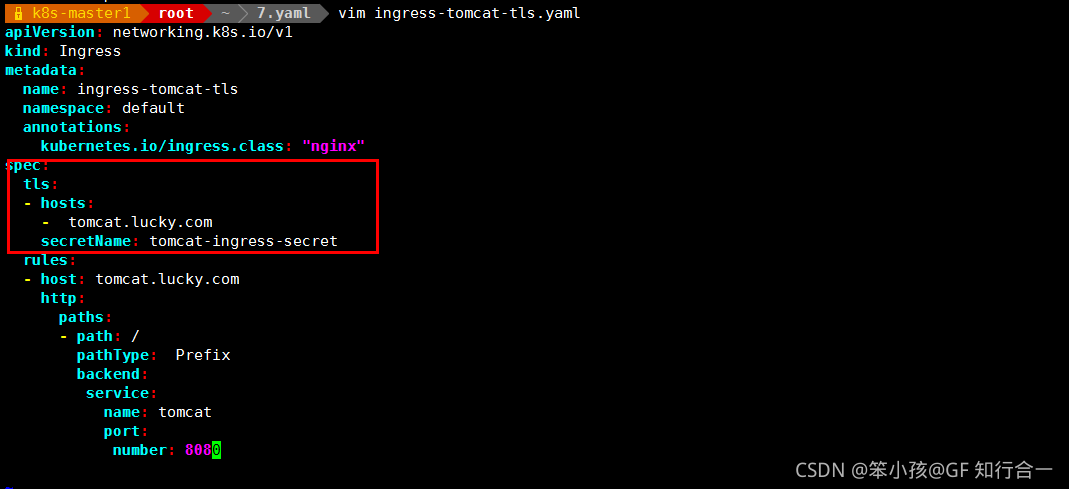

创建 Ingress

Ingress 规则可以参考官方:

https://kubernetes.io/zh/docs/concepts/services-networking/ingress/

kubectl explain ingress.spec.rules.http.paths.backend.service

vim ingress-tomcat-tls.yaml

Ingress 规则可以参考官方:

https://kubernetes.io/zh/docs/concepts/services-networking/ingress/

-

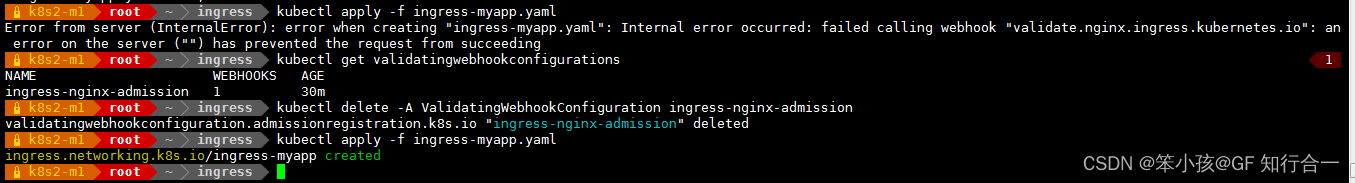

更新时提示报错

- kubectl apply -f ingress-myapp.yaml

Error from server (InternalError): error when creating "ingress-myapp.yaml": Internal error occurred: failed calling webhook "validate.nginx.ingress.kubernetes.io": an error on the server ("") has prevented the request from succeeding

kubectl get validatingwebhookconfigurations

NAME WEBHOOKS AGE

ingress-nginx-admission 1 30m

kubectl delete -A ValidatingWebhookConfiguration ingress-nginx-admission

validatingwebhookconfiguration.admissionregistration.k8s.io "ingress-nginx-admission" deleted

网站声明:如果转载,请联系本站管理员。否则一切后果自行承担。

- 上周热门

- 如何使用 StarRocks 管理和优化数据湖中的数据? 2983

- 【软件正版化】软件正版化工作要点 2900

- 统信UOS试玩黑神话:悟空 2876

- 信刻光盘安全隔离与信息交换系统 2761

- 镜舟科技与中启乘数科技达成战略合作,共筑数据服务新生态 1294

- grub引导程序无法找到指定设备和分区 1266

- 华为全联接大会2024丨软通动力分论坛精彩议程抢先看! 171

- 2024海洋能源产业融合发展论坛暨博览会同期活动-海洋能源与数字化智能化论坛成功举办 169

- 点击报名 | 京东2025校招进校行程预告 165

- 华为纯血鸿蒙正式版9月底见!但Mate 70的内情还得接着挖... 164

- 本周热议

- 我的信创开放社区兼职赚钱历程 40

- 今天你签到了吗? 27

- 信创开放社区邀请他人注册的具体步骤如下 15

- 如何玩转信创开放社区—从小白进阶到专家 15

- 方德桌面操作系统 14

- 我有15积分有什么用? 13

- 用抖音玩法闯信创开放社区——用平台宣传企业产品服务 13

- 如何让你先人一步获得悬赏问题信息?(创作者必看) 12

- 2024中国信创产业发展大会暨中国信息科技创新与应用博览会 9

- 中央国家机关政府采购中心:应当将CPU、操作系统符合安全可靠测评要求纳入采购需求 8